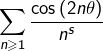

Comme la série ![]() converge, la suite

converge, la suite ![]() converge vers 0 : elle est en particulier bornée.

converge vers 0 : elle est en particulier bornée.

Notons ![]() tel que :

tel que :

![]()

![]()

Remarque

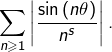

Si les deux séries ![]() et

et ![]() sont supposées semi-convergentes, alors la convergence de la série

sont supposées semi-convergentes, alors la convergence de la série ![]() n’est plus assurée en général.

n’est plus assurée en général.

Contre-exemple :

![]()

![]()

Pour tout ![]() :

:

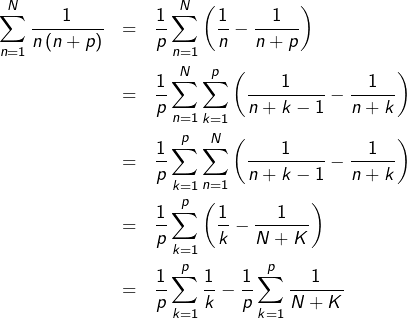

![]()

![Rendered by QuickLaTeX.com \[\fcolorbox{black}{myBlue}{$\displaystyle{\sum_{n=1}^{\infty}\frac{1}{n\left(n+p\right)}=\frac{1}{p}\sum_{k=1}^{p}\frac{1}{k}}$}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-75da9f59fcc5c3913417023f1ac980cc_l3.png)

Cette formule a été établie, dans des cas particulier, par Pietro Mengoli en 1650. A ce sujet, on pourra consulter cette vidéo.

On utilise le fait que :

![]()

![]()

![]()

![]()

Posons pour tout ![]() :

:

![Rendered by QuickLaTeX.com \[S_{n}=\sum_{k=1}^{n}u_{k}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-3304e49b79b76bc1c2d66dff8690841e_l3.png)

![Rendered by QuickLaTeX.com \[S_{n^{2}}=\sum_{q=1}^{n}\frac{1}{q^{2}}+\sum_{{1\leqslant k\leqslant n^{2}\atop k\text{ non carré}}}\frac{1}{k^{2}}\leqslant2\thinspace\sum_{k=1}^{\infty}\frac{1}{k^{2}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-776a96c817a801695585ef36959a6625_l3.png)

![Rendered by QuickLaTeX.com \[\sum_{{1\leqslant k\leqslant n^{2}\atop k\text{ non carré}}}\frac{1}{k^{2}}=\sum_{k=1}^{n^{2}}\frac{1}{k^{2}}-\sum_{k=1}^{n}\frac{1}{k^{4}}\rightarrow\zeta\left(2\right)-\zeta\left(4\right)\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-1e65eb167d9ba1edea47c624194839f6_l3.png)

![Rendered by QuickLaTeX.com \[\sum_{n=1}^{\infty}u_{n}=2\thinspace\zeta\left(2\right)-\zeta\left(4\right)=\fcolorbox{black}{myBlue}{$\displaystyle{\frac{\pi^{2}}{3}-\frac{\pi^{4}}{90}}$}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-e44879d0bb3186ed1d3dda3a69244f9e_l3.png)

Ces séries sont connues sous le nom de séries de Bertrand. Elles sont considérées comme des séries de références (au même titre que les séries géométriques ou les séries de Riemann).

Notons, pour tout ![]() :

:

![]()

- Supposons

et soit

et soit ![Rendered by QuickLaTeX.com \lambda\in\left]1,\alpha\right[.](https://math-os.com/wp-content/ql-cache/quicklatex.com-3db19441c379ffed485b3358adfc9871_l3.png) En écrivant

En écrivant  sous la forme :

sous la forme :

on constate que la suite![Rendered by QuickLaTeX.com \[u_{n}=A_{n}\;\frac{1}{n^{\lambda}}\qquad\text{avec : }A_{n}=\frac{1}{n^{\alpha-\lambda}\ln^{\beta}\left(n\right)}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-c38b85700e44912de95aa48b8ba2e951_l3.png)

est majorée par 1 APCR (puisqu’elle converge vers 0 d’après la propriété des croissances comparées). La série

est majorée par 1 APCR (puisqu’elle converge vers 0 d’après la propriété des croissances comparées). La série  est donc convergente, par comparaison avec une série de Riemann.

est donc convergente, par comparaison avec une série de Riemann. - Supposons

et soit

et soit ![Rendered by QuickLaTeX.com \mu\in\left]\alpha,1\right[.](https://math-os.com/wp-content/ql-cache/quicklatex.com-ca6713ca14295bd46657592b418b710e_l3.png) En écrivant

En écrivant  sous la forme :

sous la forme :

on constate que la suite![Rendered by QuickLaTeX.com \[u_{n}=B_{n}\:\frac{1}{n^{\mu}}\qquad\text{avec : }B_{n}=\frac{1}{n^{\alpha-\mu}\ln^{\beta}\left(n\right)}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-255f9fcc92ad191bdf2db85753e3ac3a_l3.png)

est minorée par

est minorée par  APCR (puisqu’elle diverge vers l’infini, d’après la propriété des croissances comparées). La série

APCR (puisqu’elle diverge vers l’infini, d’après la propriété des croissances comparées). La série  est donc divergente, par comparaison avec une série de Riemann.

est donc divergente, par comparaison avec une série de Riemann. - Enfin, si

on compare avec un intégrale. Pour tout

on compare avec un intégrale. Pour tout  :

:

car l’application![Rendered by QuickLaTeX.com \[\frac{1}{n\ln\left(n\right)}\geqslant\int_{n}^{n+1}\frac{1}{t\ln\left(t\right)}\thinspace dt\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-e1dcabbe57c62ffc1b063d55d666ce6c_l3.png)

décroît sur

décroît sur  Après sommation :

Après sommation :

Il s’ensuit que :![Rendered by QuickLaTeX.com \[\sum_{k=2}^{n}\frac{1}{k\ln\left(k\right)}\geqslant\int_{2}^{n+1}\frac{1}{t\ln\left(t\right)}\thinspace dt=\ln\left(\ln\left(n+1\right)\right)-\ln\left(\ln\left(2\right)\right)\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-db19a0047d66710a4657e35216ca2092_l3.png)

![Rendered by QuickLaTeX.com \[\lim_{n\rightarrow\infty}\sum_{k=2}^{n}\frac{1}{k\ln\left(k\right)}=+\infty\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-d82bcbb79b07fe88033d82c29eaf245b_l3.png)

Remarque

Une proposition analogue concernant des intégrales impropres, est présentée dans cet article.

Soient ![]() et

et ![]()

On sait (voir cet article \url{https://math-os.com/series-numeriques-partie-2/#section-5} pour les détails) que la série :

![Rendered by QuickLaTeX.com \[\sum_{n\geqslant1}\frac{e^{in\theta}}{n^{s}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-297ea6605017e562b74407189e99cd5a_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\sum_{n\geqslant1}\frac{\sin\left(n\theta\right)}{n^{s}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-346589680177751eb9f35f40319f14dc_l3.png)

![]()

converge (car

converge (car

Il suffit d’appliquer la règle d’Abel. En effet, la suite ![]() converge vers

converge vers ![]() en décroissant et la suite de terme général :

en décroissant et la suite de terme général :

![Rendered by QuickLaTeX.com \[ S{n}=\sum_{k=1}^{n}u_{k}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-a1854b9c020579fbd0cb4337f91d907f_l3.png)

Bon. Tous comptes faits, cet exercice aurait mérité un petit pictogramme vert. C’est juste l’intervention de la règle d’Abel qui m’a fait hésiter …

Question 1

La série ![]() converge d’après la règle de d’Alembert. En effet, si l’on pose

converge d’après la règle de d’Alembert. En effet, si l’on pose ![]() alors pour tout

alors pour tout ![]() :

:

![Rendered by QuickLaTeX.com \[\frac{u_{n+1}}{u_{n}}=\frac{\frac{1}{\left(n+1\right)!}}{\frac{1}{n!}}=\frac{1}{n+1}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-6e90af96e8b828ceb6ca04913a0595da_l3.png)

Pour calculer sa somme, appliquons la formule de Taylor avec reste intégral à la fonction exponentielle. Pour tout

![Rendered by QuickLaTeX.com \[e^{x}=\sum_{k=0}^{n}\frac{x^{k}}{k!}+\int_{0}^{x}\frac{\left(x-t\right)^{n}}{n!}\thinspace e^{t}\thinspace dt\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-049100d1142159e5b3d6b6f2ad4ca689_l3.png)

![]()

![Rendered by QuickLaTeX.com \[S_{n}=\sum_{k=0}^{n}\frac{1}{k!}\qquad\text{et}\qquad I_{n}=\int_{0}^{1}\frac{\left(1-t\right)^{n}}{n!}\thinspace e^{t}\thinspace dt\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-5e4a68dedac4f2c02b4c18601c251934_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\fcolorbox{black}{myBlue}{$\displaystyle{\sum_{k=0}^{\infty}\frac{1}{k!}=e}$}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-24c571f249783716fbfbf227b83ce66f_l3.png)

Remarque 1

La preuve préalable de la convergence via la règle de d’Alembert était superflue, puisque la suite du calcul prouve la convergence (et donne en prime la valeur de la somme).

Remarque 2

On notera que ![]() où :

où :

![Rendered by QuickLaTeX.com \[R_{n}=\sum_{k=n+1}^{\infty}\frac{1}{k!}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-eb121700223337e62f296211d0b4837f_l3.png)

Remarque 3

D’une manière générale (et par une preuve similaire, reposant sur la formule de Taylor avec reste intégral) :

![Rendered by QuickLaTeX.com \[\boxed{\forall x\in\mathbb{R},\thinspace e^{x}=\sum_{n=0}^{\infty}\frac{x^{n}}{n!}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-35188f7dcf278ae28ce557cb1bb208e9_l3.png)

Question 2

D’évidence, le reste est minoré par son premier terme :

![]()

![Rendered by QuickLaTeX.com \[\frac{1}{k!}=\frac{1}{\left(n+1\right)!}\thinspace\prod_{j=n+2}^{k}\frac{1}{j}\leqslant\frac{1}{n!}\:\frac{1}{\left(n+1\right)^{k-n-1}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-60f872e0dcb170459f1dcf3d90f17062_l3.png)

![Rendered by QuickLaTeX.com \[R_{n}\leqslant\frac{1}{\left(n+1\right)!}\sum_{k=n+1}^{\infty}\frac{1}{\left(n+1\right)^{k-n-1}}=\frac{1}{\left(n+1\right)!}\sum_{k=0}^{\infty}\frac{1}{\left(n+1\right)^{k}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-a4cd5dd4c3d56940ac68be042fb1798c_l3.png)

![Rendered by QuickLaTeX.com \[\sum_{k=0}^{\infty}\frac{1}{\left(n+1\right)^{k}}=\frac{1}{1-\frac{1}{n+1}}=\frac{n+1}{n}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-436049ec0792cdde0fd3352879835481_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\boxed{\forall n\in\mathbb{N}^{\star},\thinspace\frac{1}{\left(n+1\right)!}\leqslant R_{n}\leqslant\frac{1}{n\thinspace n!}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-4a57588e6d3c231fecf08770a27f1918_l3.png)

Question 3

Avec les notations introduits précédemment, à savoir :

![Rendered by QuickLaTeX.com \[S_{n}=\sum_{k=0}^{n}\frac{1}{k!}\qquad\text{et}\qquad R_{n}=\sum_{k=n+1}^{\infty}\frac{1}{k!}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-dcce90985e49a367f024e24972df96d4_l3.png)

![]()

![Rendered by QuickLaTeX.com \[n!\thinspace S_{n}=\sum_{k=0}^{n}\frac{n!}{k!}=n+1+P_{n}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-e147a28432015b7de52a1d4e117e6480_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\frac{\left(n+1\right)!R_{n+1}}{n!R_{n}}=\left(n+1\right)\thinspace\frac{R_{n+1}}{R_{n}}\leqslant\left(n+1\right)\thinspace\frac{\frac{1}{\left(n+1\right)\left(n+1\right)!}}{\frac{1}{\left(n+1\right)!}}=1\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-055a2de9b67cd409cfa5f4f2a25d7a70_l3.png)

Le résultat établi dans cet exercice est connu sous le nom de théorème de Mertens.

Notons pour tout ![]() :

:

![Rendered by QuickLaTeX.com \[A_{n}=\sum_{k=0}^{n}a_{k}\qquad B_{n}=\sum_{k=0}^{n}b_{k},\qquad A'_{n}=\sum_{k=0}^{n}\left|a'_{k}\right| \]](https://math-os.com/wp-content/ql-cache/quicklatex.com-c326b630b2fcad361414568ca5c760e5_l3.png)

![Rendered by QuickLaTeX.com \[X_{n}=\sum_{k=0}^{n}\left(\sum_{j=0}^{k}a_{j}b_{k-j}\right)\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-220f4e0b9f9282c67e55f3ea5728f52f_l3.png)

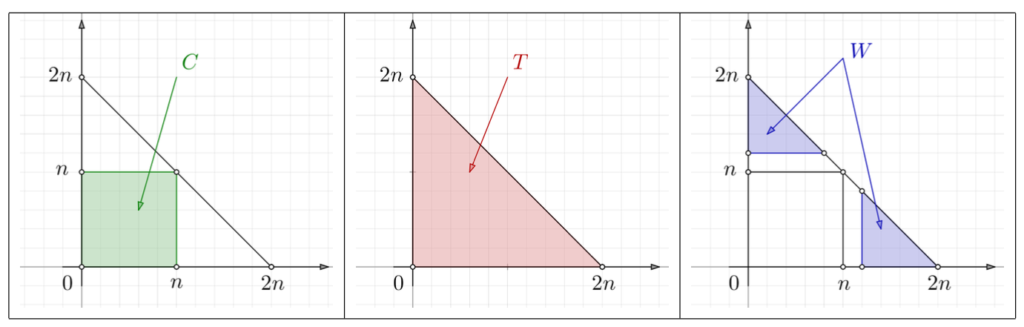

D’une part :

![Rendered by QuickLaTeX.com \[\boxed{A_{n}B_{n}=\sum_{\left(i,j\right)\in C}a_{i}b_{j}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-f9bd13873fa65eebea2ebf9e511b1b83_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\boxed{X_{2n}=\sum_{\left(i,j\right)\in T}a_{i}b_{j}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-9a22eab07ef9b1a863002ec3e1a00a0c_l3.png)

![]()

![Rendered by QuickLaTeX.com \[\boxed{\Delta_{n}=\sum_{\left(i,j\right)\in W}a_{i}b_{j}}\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-c57439fb97a8452b7d819db92acf2e98_l3.png)

![]()

De manière plus explicite :

![]()

![]()

![]()

![]()

![]()

![]()

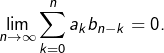

Lemme

Si ![]() ACV et si

ACV et si ![]() alors

alors

Preuve (cliquer pour déplier / replier)

Notons ![]() Etant donné

Etant donné ![]() il existe

il existe ![]() tel que

tel que

![Rendered by QuickLaTeX.com \[n\geqslant N\Rightarrow\sum_{k=1+p_{n}}^{n}\left|a_{k}\right|\leqslant\epsilon\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-4a8f2056dc372c5d08fb1c3bfc3cd66f_l3.png)

![Rendered by QuickLaTeX.com \[\forall n\in\mathbb{N},\,\sum_{k=0}^{n}\left|a_{k}\right|\leqslant M\]](https://math-os.com/wp-content/ql-cache/quicklatex.com-08e74c7589343520bd226d918f06cfc5_l3.png)

![]()

![]()

Si un point n’est pas clair ou vous paraît insuffisamment détaillé, n’hésitez pas à poster un commentaire ou à me joindre via le formulaire de contact.